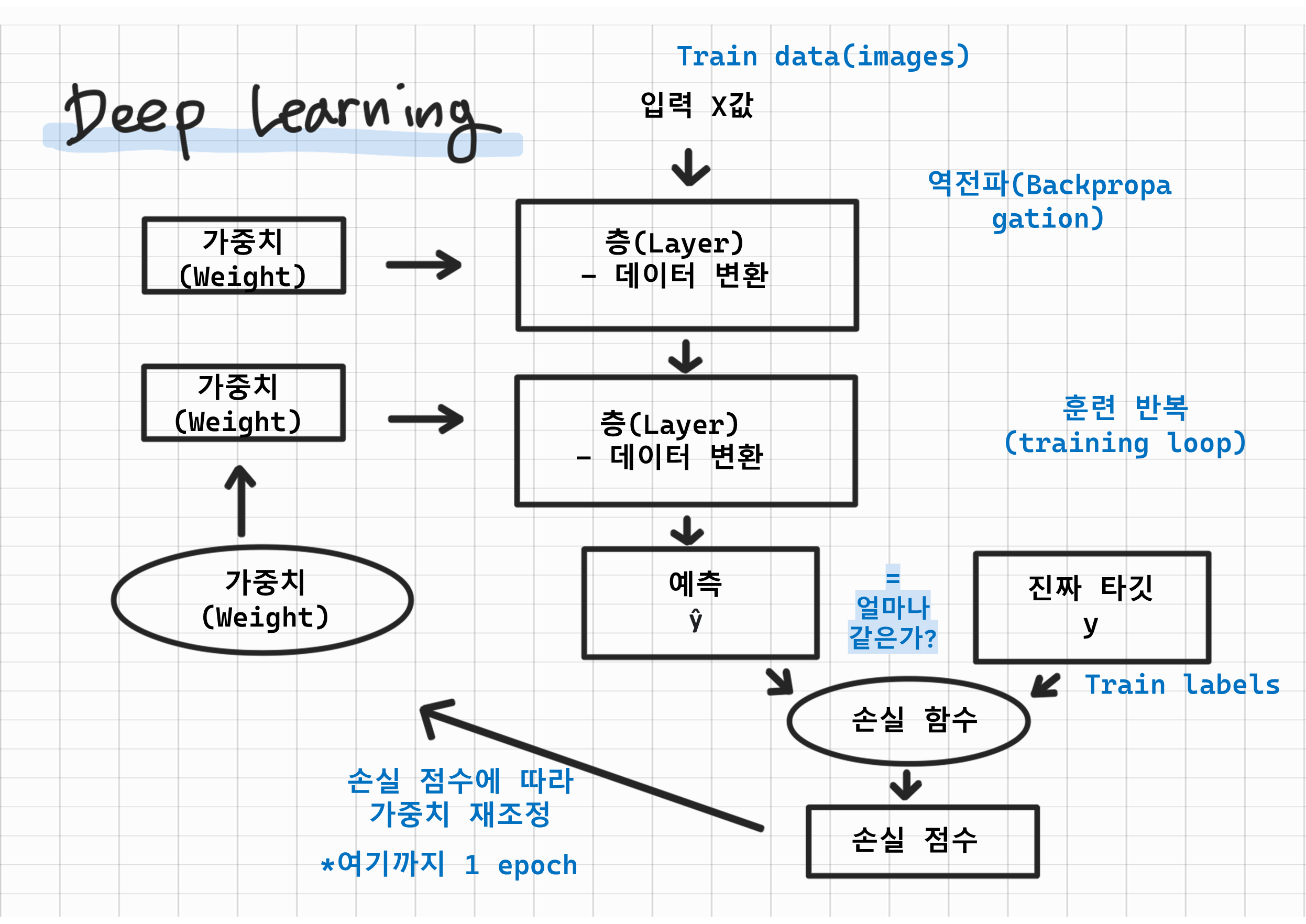

딥러닝 Training 과정을 살펴보자.

딥러닝?

원본 입력(숫자3)→□(hidden layer1)→□(hidden layer2)→□(hidden layer3)→□(hidden layer4)→□□■□□□□□□(최종 출력)

위의 구조는 딥러닝의 일반적인 구성을 나타내는 것이다. 딥러닝은 인공 신경망의 한 종류로, 다양한 은닉층(hidden layer)을 거치면서 입력 데이터를 최종 출력으로 변환하는 과정을 수행한다.

딥러닝은 원본 입력 데이터(예: 숫자 3)을 네트워크의 첫 번째 은닉층(hidden layer1)에 입력한다. 은닉층은 입력 데이터에 가중치(weight)를 곱하고 편향(bias)을 더한 후, 활성화 함수(activation function)를 적용하여 출력값을 계산한다. 이렇게 계산된 값을 다음 은닉층(hidden layer2)에 입력으로 전달한다.

이러한 과정은 은닉층(hidden layer3)과 은닉층(hidden layer4)를 거치면서 반복된다. 각 은닉층은 이전 은닉층의 출력을 입력으로 받아 가중치와 편향을 곱하고 활성화 함수를 적용하여 출력값을 계산한다. 이런 식으로 최종적으로 출력층(output layer)에 도달하게 되며, 출력층에서는 최종 예측값을 얻는다.

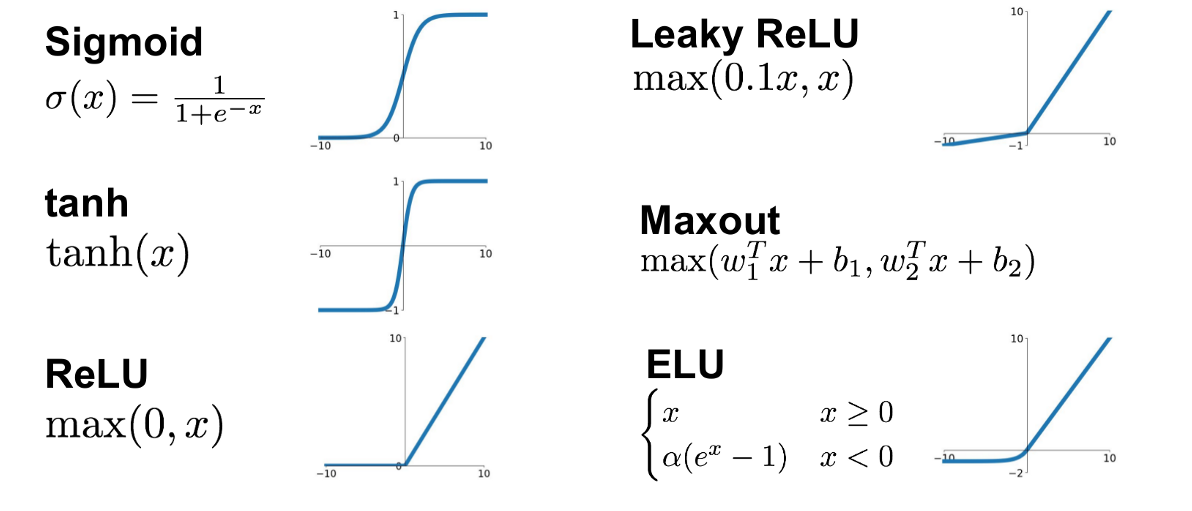

딥러닝에서는 일반적으로 활성화 함수로는 비선형 함수를 사용한. 비선형 함수를 사용함으로써 딥러닝은 복잡한 비선형 관계를 모델링할 수 있다. 또한, 역전파(backpropagation) 알고리즘을 사용하여 예측 결과와 실제값의 오차를 최소화하기 위해 가중치와 편향을 조정하면서 학습이 이루어진다.

딥러닝은 복잡한 패턴인식, 분류, 회귀 등 다양한 문제를 다룰 수 있으며, 이미지 인식, 자연어 처리, 음성인식 등 다양한 분야에서 많은 성과를 이루고 있다.

- 손실 함수(cost function 또는 loss funtion)

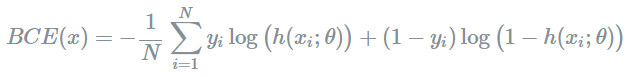

Binary cross-entropy, Categorical cross-entropy

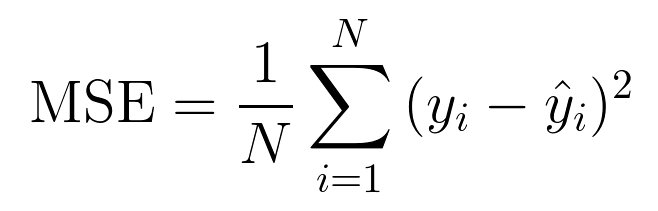

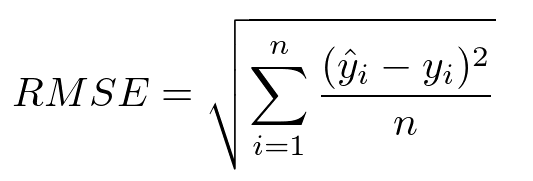

일반적으로 신경망 학습에서는 평균제곱오차(MSE)와 교차 엔트로피 오차(cross entropy error)를 사용한다. 손실함수의 함수값이 최소화 되도록 하는 가중치(weight)와 편향(bias)를 찾는 것이 딥러닝 학습의 목표이다.

MSE(Mean squared error) - 오차가 양수, 음수에 상관없이 증가된다.

---------------------------------------------------------------------------------------------------------------------------------------

RMSE(Root mean squared error) - 오류의 제곱을 구해 값의 왜곡을 줄인다.

---------------------------------------------------------------------------------------------------------------------------------------

Binary Crossentropy

---------------------------------------------------------------------------------------------------------------------------------------

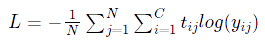

Categorical Crossentropy

- 활성 함수(activation function)

Sigmoid: 이진 분류 문제에 적합

tanh(hyperV): sigmoid의 가파른 버전

Softmax: 다중 분류 문제에 적합

ReLu: 일반적으로 사용됨

Leaky ReLu: Regression 문제에 적합 (ELU도 사용하긴 하나 많이 사용되진X)

Maxout: 큰값 사용

'MS AI School' 카테고리의 다른 글

| DAY 30 - 모델 저장 및 불러오기 .PKL (0) | 2022.12.06 |

|---|---|

| DAY 29 - Docker 도커? (0) | 2022.12.06 |

| DAY 27 - 딥러닝 프레임워크 Keras (0) | 2022.11.29 |

| Day 26 - 신경망 구조(퍼셉트론, 논리회로, 활성화 함수) (0) | 2022.11.29 |

| Day 25 - 신경망 데이터(텐서, 1차원, 2차원, 3차원..) (0) | 2022.11.29 |